Le LNE a inauguré sa deuxième plate-forme pour l’évaluation de l’IA

Un an après le lancement de la LE.IA Simulation, la plate-forme LE.IA Immersion du Laboratoire national de métrologie et d’essais (LNE) est désormais opérationnelle pour l’évaluation de systèmes « intelligents » tels des robots à roues et des drones au sein d’un environnement virtuel, grâce à la vidéoprojection.

Le Laboratoire national de métrologie et d’essais (LNE), en la personne de son directeur général, Thomas Grenon, a inauguré, le 14 mai dernier, sa plate-forme LE.IA Immersion sur son site de Trappes (Yvelines) en mettant les petits plats dans les grands. Avec, notamment, la présence de Jean-Michel Fourgous, président de l’agglomération de Saint-Quentin-en-Yvelines, de Georges-Étienne Faure, directeur du pôle Souveraineté numérique au Secrétariat général pour l’investissement, de Bruno Sportisse, P-DG de l’Institut national de recherche en sciences et technologies du numérique (Inria), d’une partie du personnel, etc.

© Philippe Stroppa

« Nous sommes aujourd’hui mieux équiper à appréhender les révolutions induites par l’IA. Il ne faut, évidemment, pas tomber dans l’excès inverse, qui serait celui de la peur irraisonnée. La technologie n’est ni bonne, ni mauvaise, elle doit être maîtrisée. Et, pour être maîtrisée, l’IA doit être évaluée », veut croire Georges-Étienne Faure (voir troisième photographie). « Le Laboratoire d’évaluation de l’intelligence artificielle (LE.IA) est, à ce jour, un laboratoire multi-approches unique au monde pour la caractérisation métrologique des systèmes “intelligents”. Seuls les États-Unis, avec le NIST, et le Japon, avec le NII, peuvent rivaliser avec nous », affirme Thomas Grenon (voir ci-contre).

Mais l’histoire de l’intelligence artificielle au sein du LNE remonte à près d’une décennie et demi plus tôt, avec la création d’une équipe spécialisée en 2008, à la demande de la Direction générale de l’armement (DGA). « Le sujet portait, à l’époque, sur l’évaluation de systèmes de traitement du langage, et plus particulièrement sur des logiciels de traduction du pachtoune en français. L’équipe s’est ensuite étoffée, et continue toujours de s’étoffer puisque nous allons accueillir une 16e personne le mois prochain. Nous couvrons aujourd’hui l’IA au travers d’une expérience acquise dans de nombreux domaines, tels que les langues, donc, la robotique, la mobilité autonome, etc. », rappelle Agnès Delaborde, Head of Department AI Evaluation and Cybersecurity du LNE.

Un laboratoire, trois plates-formes à terme

Afin d’accompagner et d’anticiper l’entrée en vigueur de l’AI Act, le LNE a créé, en 2021, le tout premier référentiel de certification volontaire pour l’IA. Construit avec des acteurs du marché, « ce référentiel de bonnes pratiques définit des exigences liées aux processus de conception, de développement, d’évaluation et de MCO (maintien en conditions opérationnelles) d’une IA », précise Agnès Delaborde.

La LE.IA Immersion, quant à elle, est l’une des trois plates-formes qui vont constituer, à terme, le laboratoire d’évaluation de l’intelligence artificielle. « Si l’IA est porteuse d’espoir, elle suscite aussi de l’inquiétude, comme nous le rappelle les derniers débats sur l’IA générative. C’est pour répondre aux enjeux essentiels de souveraineté, d’innovation et de compétitivité qu’a été imaginé le LE.IA dès 2018. Cette année-là, le Président de la République initie la stratégie nationale pour l’IA, afin que la France devienne un leader de ce domaine. Il souligne le rôle primordial de l’évaluation des IA via des référentiels, méthodes et outils à inventer, et lance, dans le cadre de France 2030, le grand défi de sécuriser, certifier et fiabiliser les systèmes fondés sur l’IA », rappelle Thomas Grenon.

© Philippe Stroppa

Les systèmes « intelligents » ne pouvant pas être évalués par une simple analyse – on parle de boîtes noires – , tester l’efficacité, la robustesse, la sécurité et l’éthique d’une IA nécessite en effet une métrologie (une science de la mesure) particulièrement complexe. « L’évaluation d’une intelligence artificielle consiste non seulement en la caractérisation d’un objet ou d’un système, mais aussi en l’évaluation de conformité. Pour cela, différentes approches sont disponibles pour réaliser ces essais », explique Agnès Delaborde.

La plate-forme LE.IA Simulation, qui est déployée de début 2023, teste un système « intelligent » sur tous les critères possibles grâce à la simulation numérique, afin d’évaluer les performances du système. Par exemple pour un robot ou une caméra dotée de fonctionnalités d’IA, seule l’IA embarquée, qui est intégrée dans un environnement simulé par la LE.IA Simulation, est évaluée. Une troisième plate-forme, la LE.IA Action, qui sera constituée d’une chambre climatique et de caméras de tracking et qui sera opérationnelle en 2025, plongera le système en situation réelle, répétable et standardisé pour qualifie la mobilité, la dextérité ou d’autres modalités de perception d’un robot agricole, par exemple.

Immerger le système dans une réalité simulée

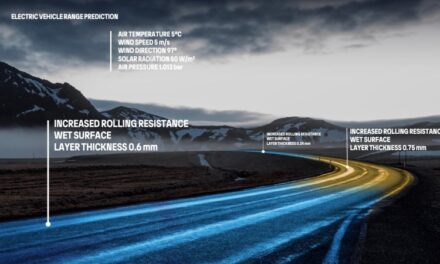

Enfin, la nouvelle plate-forme LE.AI Immersion met en situation le système au sein d’un environnement virtuel, grâce à la vidéoprojection (plate-forme hybride), afin de tester ses caractéristiques d’asservissement et de prise de décision dans un environnement donné. Il est ainsi possible de qualifier les performances de mobilité d’un système, son temps de réaction, le fonctionnement de son algorithme en situation réelle. Le logiciel de simulation en temps réel constitue l’élément central de la plate-forme, en générant des scénarios de test dynamiques et réalistes.

Ce banc d’essais s’articule autour d’écran de projection conique, agissant comme un lien direct entre le simulateur et le système, écran associé à six projecteurs permettant de couvrir un champ de 300°, d’un convoyeur avec bandes roulantes pour simuler une vitesse maximale de déplacement de 30 km/h, une pente descendante ou montante – le plateau supporte une charge maximale de 300 kg en suspension, ou de 590 kg au sol, et peut s’élever jusqu’à une hauteur de 2,5 m – , et de caméras de tracking, ainsi que d’un bras robotisé.

Georges-Étienne Faure, directeur du pôle Souveraineté numérique au Secrétariat général pour l’investissement.

Pour effectuer des conditions les plus réalistes et variées possibles, le LNE a ajouté trois projecteurs de théâtre, pour créer des effets d’éblouissement, et des haut-parleurs pour reproduire un environnement sonore, ajoutant ainsi une dimension sensorielle réaliste supplémentaire – comment un robot gère une voix humaine dans un environnement bruyant, par exemple. Le LE.IA Immersion représente un investissement d’un montant de 1,5 million d’euros, l’investissement total pour le LE.IA étant de l’ordre de 2,5 M€, hors ressources humaines.

En plus de disposer de résultats fiables et reproductibles grâce à une synchronisation précise entre simulation et comportement physique, les développeurs d’une grande variété de robots (robots à roues différentielles ou Ackermann, robots à chenilles, bipèdes et quadripèdes) peuvent explorer différentes configurations. « Les secteurs applicatifs sont d’abord la logistique, l’agriculture, puis l’agroalimentaire, la santé et le véhicule autonome, les drones. Mais nous nous limitons pas à ces seuls secteurs », affirme Agnès Delaborde.

Une nouvelle branche des sciences de la mesure

Chacune des trois plates-formes va encore évoluer avec l’implémentation de nouvelles briques, de nouveaux modèles de simulation, et d’autres plates-formes seront aussi progressivement ajoutées, en particulier, pour l’évaluation des IA génératives. « L’évaluation de l’intelligence artificielle est un axe stratégique majeur pour le LNE, parce que cette technologie va réellement bouleverser le monde. C’est d’ailleurs une nouvelle branche des sciences de la mesure qui s’ouvre », constate Thomas Grenon.

© Philippe Stroppa

Le LE.IA est un outil déterminant pour accompagner l’essor des technologies « intelligentes », non seulement pour mesurer, comparer et améliorer leur efficacité, mais aussi pour s’assurer du respect de nos valeurs éthiques, françaises et européennes. Le laboratoire jouera d’ailleurs un rôle déterminant dans le développement des Testing Experimentation Facilities (TEF), ces sites de référence voulus par la Commission européenne pour aider les industriels à tester leurs technologies et, ainsi, soutenir le déploiement d’une IA souveraine et éthique en Europe.

« Parce qu’une IA de confiance, c’est aussi une IA soutenable d’un point de vue sociétal et environnemental, nous aurons besoin du LNE pour ces travaux à venir, ainsi que pour la caractérisation des systèmes d’IA les plus avancés au profit de la compétitivité économique et d’acceptation sociétale des IA fabriquées en France, tout comme le LNE peut compter sur nous et sur le soutien de l’État », conclut Georges-Étienne Faure.